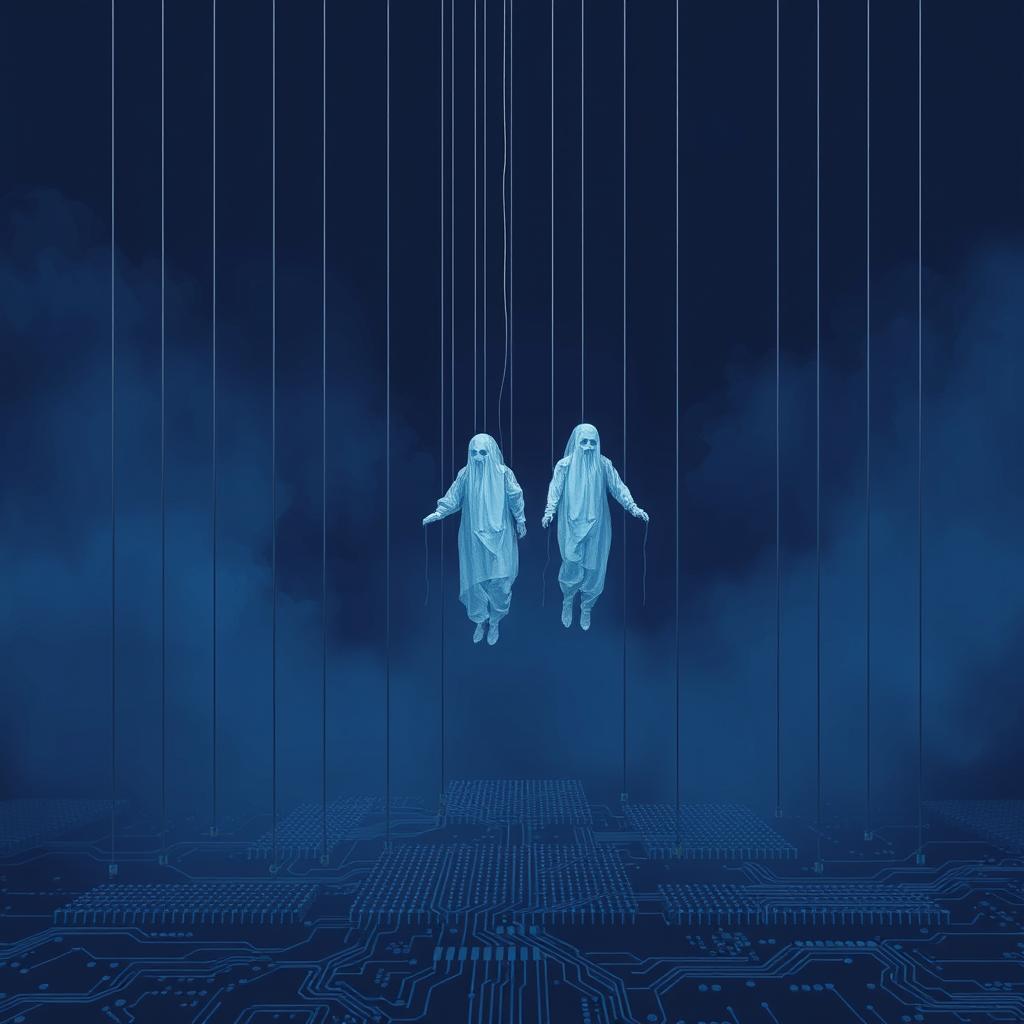

Agentic Coding: Die Kontroll-Illusion – Warum KI-Agenten die neuen BWL-Berater sind

80 Prozent der Entwickler nutzen KI-Agenten in ihren Workflows. Gleichzeitig ist das Vertrauen in die Genauigkeit dieser Agenten von 40 auf 29 Prozent gefallen – innerhalb eines Jahres. [1] Diese Schere zwischen Adoption und Vertrauen ist kein Paradox. Sie ist das exakte Muster, das Unternehmen seit Jahrzehnten mit externen Beratern durchleben: Man kauft sich Kompetenz ein, die man nicht versteht, erklärt den Einkauf zum Fortschritt – und wundert sich, wenn die Ergebnisse nicht dem entsprechen, was auf der PowerPoint stand.

Agentic Coding ist das Buzzword des Jahres 2026. Die Versprechen sind gewaltig: Agenten, die eigenständig Code schreiben, Pull Requests erstellen, Bugs fixen und ganze Features implementieren – während der Entwickler zum Orchestrator aufsteigt. Anthropics Agentic Coding Trends Report dokumentiert den Wandel in Zahlen. [2] Doch hinter den Produktivitätsmetriken verbirgt sich eine unangenehme Wahrheit: Wir wiederholen die Fehler des Berater-Zeitalters – nur schneller, teurer und mit weniger Rückholbarkeit.

Das Berater-Muster: Outsourcing als Kontrollverlust

In den 1990er und 2000er Jahren erlebte die Unternehmensberatung ihren Zenit. McKinsey, BCG und Bain verkauften nicht nur Expertise – sie verkauften die Illusion, dass komplexe organisatorische Probleme durch externe Analyse lösbar sind. Das Muster war immer dasselbe: Ein Unternehmen erkennt, dass es ein Problem hat. Es beauftragt Berater, die das Problem in Frameworks pressen, die das Management versteht. Das Management fühlt sich informiert. Die eigentliche Komplexität bleibt unsichtbar.

KI-Agenten reproduzieren dieses Muster auf der technischen Ebene. Ein Entwicklerteam steht unter Druck, schneller zu liefern. Es setzt Coding-Agenten ein, die Code generieren, den das Team in der Geschwindigkeit nicht mehr vollständig reviewen kann. Das Team fühlt sich produktiv. Die eigentliche Komplexität – Architekturentscheidungen, Seiteneffekte, technische Schulden – bleibt unsichtbar.

Der Unterschied: BWL-Berater hinterließen PowerPoints, die man ignorieren konnte. KI-Agenten hinterlassen Code, der in Produktion läuft.

McKinsey hat das übrigens erkannt – und sich angepasst. QuantumBlack, McKinseys KI-Division, veröffentlichte im Februar 2026 einen detaillierten Bericht über Agentic Workflows in der Softwareentwicklung. [3] Die Ironie ist schwer zu übersehen: Die Beratungsbranche berät jetzt darüber, wie man den Einsatz von KI-Beratern optimiert. Die Meta-Ebene des Outsourcings hat eine neue Stufe erreicht.

Das 80-Prozent-Problem: Die gefährlichste Zahl im Agentic Coding

Die Industrie hat ein neues Lieblingsnarrativ: KI-Agenten lösen 80 Prozent eines Problems in Minuten. Der Rest ist menschliche Feinarbeit. Das klingt nach einem fantastischen Deal – bis man versteht, was die restlichen 20 Prozent bedeuten.

Die 80 Prozent, die ein Agent liefert, sind der einfache Teil. Boilerplate. Standardmuster. Code, der syntaktisch korrekt ist und alle offensichtlichen Tests besteht. Die 20 Prozent, die übrig bleiben, sind die Architekturentscheidungen, die Edge Cases, die Sicherheitsimplikationen, die Performance-Optimierungen – alles, was ein System von einem funktionierenden Prototyp in produktionsreife Software verwandelt. [1]

Das Problem: Die 80 Prozent erzeugen das Gefühl von Fortschritt. Dashboards zeigen steigende Commit-Zahlen. Sprint-Velocities explodieren. Das Management sieht Grafiken, die nach oben zeigen. Aber die verbleibenden 20 Prozent erzeugen compounding costs – versteckte, sich aufschichtende Kosten, die erst Monate später als technische Schulden, Sicherheitslücken oder unerklärliche Bugs sichtbar werden.

66 Prozent der Entwickler sagen, dass KI-Lösungen, die „fast richtig, aber nicht ganz" sind, ihre größte Frustration darstellen. [1] Zwei Drittel berichten, dass sie mehr Zeit mit dem Reparieren von imperfektem KI-generierten Code verbringen, als sie einsparen. Das ist kein Produktivitätsgewinn. Das ist ein Produktivitätskredit mit versteckten Zinsen.

Die Intransparenz-Maschine: Warum niemand mehr versteht, was passiert

Wenn ein BWL-Berater eine Empfehlung ausspricht, kann man ihn zumindest fragen, warum. Die Antwort mag unbefriedigend sein, aber es gibt eine. Bei KI-Agenten existiert diese Möglichkeit nur noch eingeschränkt. Unternehmen bewegen sich von deterministischer Software zu probabilistischer KI, bei der autonome Systeme Entscheidungen auf Basis gelernter Muster und Echtzeit-Kontext treffen. [4]

Wenn ein Agent entscheidet, einen neuen Cloud-Server zu provisionieren, eine Datenbanktabelle zu löschen oder sensible Finanzdokumente zu teilen, tut er das mit einem Reasoning-Prozess, der für seine menschlichen Operatoren oft opak ist. Dieser Mangel an Transparenz erzeugt einen massiven blinden Fleck: Wenn wir nicht sehen können, warum ein Agent eine Aktion durchgeführt hat, können wir ihn nicht effektiv steuern, absichern oder ihm vertrauen.

Das Meta-Harness-Paper von Stanford und MIT beschreibt eine noch tiefere Ebene des Problems: Der Harness – der Steuerungscode um ein KI-Modell – ist für dessen Leistung genauso wichtig wie die Modellgewichte selbst. [5] Selbst-evolvierende Software, bei der KI-Systeme ihren eigenen Steuerungscode iterativ verbessern, wird zum dominanten Paradigma. Aber wenn der Agent nicht nur den Anwendungscode schreibt, sondern auch seinen eigenen Orchestrierungscode optimiert, wer versteht dann noch das Gesamtsystem?

Die Antwort: niemand. Und genau das ist der Punkt, an dem die Berater-Analogie zusammenbricht. Denn beim Berater konnte man im schlimmsten Fall die Empfehlung in die Schublade legen. Beim selbst-optimierenden Agenten gibt es keine Schublade.

AI Slop: Die technische Schuld der neuen Ära

Die Industrie hat einen Begriff für das Problem: AI Slop. Code, der auf der Oberfläche vernünftig aussieht, aber kein ordentliches Error-Handling hat, Sicherheitslücken einführt, bestehende Funktionalität bricht oder unwartbare Architektur erzeugt. [1] Ohne strukturierte Aufsicht generiert KI Code, der technische Schulden schneller aufbaut, als er Wert schafft.

Ein Agent, der 1.000 Pull Requests pro Woche schreibt – keine Science-Fiction, sondern die Realität in großen Entwicklungsorganisationen – und eine Vulnerabilitätsrate von nur einem Prozent hat, erzeugt zehn neue Sicherheitslücken wöchentlich. [1] Agenten, die auf APIs, Datenbanken und externe Services zugreifen, schaffen neue Angriffsvektoren. Die Skalierung, die als Vorteil verkauft wird, ist gleichzeitig der größte Risikofaktor.

Paperclip, eine Open-Source-Plattform für Multi-Agent-Orchestrierung, adressiert einen Teil des Problems mit zentraler Übersicht über Tasks, Entscheidungen und Kosten. [6] Die Metapher ist bezeichnend: Der Mensch ist das „Board of Directors", ein CEO-Agent managt andere Agenten. Aber genau wie im echten Unternehmen gilt: Ein Board, das die operative Ebene nicht versteht, ist kein Steuerungsorgan – es ist ein Legitimationsinstrument.

GitHub hat das verstanden und im März 2026 massiv in Governance-, Audit- und Stabilitätsinfrastruktur investiert. [7] Tracing für Prompts, Tools und Ausführungen. Metriken für Kosten, Latenz, Erfolgsrate und Defektrate. Audit-Logs für Tool-Aktionen und Datenzugriffe. Der Grund: Unternehmen widerstehen KI-assistierter Entwicklung nicht, weil sie bezweifeln, dass sie Code schreiben kann. Sie widerstehen, weil sie nicht erklären, auditieren oder kontrollieren können, was der Agent getan hat, wann er es getan hat und welches Modell er verwendet hat.

Der eigentliche Durchbruch: Architektur statt Automatisierung

Die Lösung liegt nicht in besseren Agenten. Sie liegt in einem fundamentalen Umdenken darüber, wie Software gebaut wird, wenn Agenten Teil des Teams sind.

Addy Osmani, einer der einflussreichsten Stimmen in der Webentwicklung, beschreibt die Zukunft als Übergang von Dirigenten zu Orchestratoren. [8] Der Unterschied ist subtil, aber entscheidend: Ein Dirigent gibt jede Note vor. Ein Orchestrator definiert die Komposition und lässt die Musiker interpretieren. Übertragen auf Software: Statt Agenten Zeile für Zeile zu steuern, müssen wir Architekturen schaffen, die agentenkompatibel sind.

Das bedeutet konkret: Systeme, die aus kleinen, unabhängig testbaren Modulen bestehen. Klare Interfaces zwischen Mensch und Agent. Automatisierte Guardrails, die nicht nur prüfen, ob der Code kompiliert, sondern ob er den Architekturprinzipien entspricht. Und vor allem: Teamstrukturen, die nicht den Agenten als Ersatz für den Entwickler sehen, sondern als Werkzeug, das nur so gut ist wie die Architektur, in der es operiert.

Wes Roth bringt es auf den Punkt: Die zentrale Fähigkeit der Zukunft ist nicht Prompt-Engineering, sondern KI-assistierte Ausführung – die Fähigkeit, einem Agenten den richtigen Kontext zu geben. [9] Aber „den richtigen Kontext geben" setzt voraus, dass man versteht, was der richtige Kontext ist. Und genau hier scheitern die meisten Organisationen – nicht an der Technologie, sondern an der eigenen Strukturkompetenz.

Das Ende der Berater-Illusion

Die Geschichte der Unternehmensberatung lehrt eine unbequeme Lektion: Outsourcing von Kompetenz funktioniert nur, wenn die einkaufende Organisation genug Eigenkompetenz behält, um die Ergebnisse zu bewerten. Unternehmen, die ihre gesamte Strategiekompetenz an Berater auslagerten, verloren die Fähigkeit, gute von schlechten Empfehlungen zu unterscheiden. Sie wurden abhängig von dem, was sie steuern wollten.

Agentic Coding steht an genau diesem Scheideweg. Teams, die Agenten als Produktivitäts-Boost verstehen und die eingesparte Zeit nutzen, um Architektur, Reviews und Systemverständnis zu vertiefen, werden profitieren. Teams, die Agenten als Ersatz für Verständnis einsetzen, werden in zwölf Monaten vor einer Codebasis stehen, die niemand mehr versteht – geschrieben von Agenten, die niemand mehr kontrolliert, optimiert von Meta-Harnesses, die niemand mehr auditiert.

Der Anthropic-Report zeigt den Weg: Structured Oversight. Nicht als Bremse, sondern als Voraussetzung für Geschwindigkeit. [2] Nicht Vertrauen in den Agenten, sondern Vertrauen in die Architektur, in der der Agent operiert. Nicht Kontrolle über den Output, sondern Kontrolle über die Rahmenbedingungen.

Die BWL-Berater des digitalen Zeitalters sind da. Die Frage ist nicht, ob wir sie einsetzen. Die Frage ist, ob wir diesmal klug genug sind, die Lektion zu lernen, bevor wir den Preis zahlen.

Referenzen

- Agentic Coding in 2026: AI's Impact on Software Development – Statistiken zu Adoption, Vertrauen und dem 80%-Problem, Times of AI, 2026

https://www.timesofai.com/industry-insights/agentic-coding-in-software-development/ - 2026 Agentic Coding Trends Report – Anthropics umfassende Analyse der Trends im agentischen Coding, Anthropic, 2026

https://resources.anthropic.com/hubfs/2026%20Agentic%20Coding%20Trends%20Report.pdf - Agentic Workflows for Software Development – McKinseys QuantumBlack über agentische Workflows, Medium/QuantumBlack, Februar 2026

https://medium.com/quantumblack/agentic-workflows-for-software-development-dc8e64f4a79d - Transparency and Explainability in Agentic AI Decision-Making – Analyse der Transparenz-Probleme bei autonomen KI-Systemen, Security Boulevard, Januar 2026

https://securityboulevard.com/2026/01/transparency-and-explainability-in-agentic-ai-decision-making/ - AI Self EVOLUTION – Meta-Harness: Automatische Optimierung von Agenten-Harnesses, Stanford/MIT, 2026

https://www.youtube.com/watch?v=61JUHDK-em8 - How To Run a Zero-Human Company – Paperclip Multi-Agent Orchestration Platform, 2026

https://www.youtube.com/watch?v=rx4w6zhrhPY - GitHub Is Building the Accountability Layer That Enterprise AI Agents Need – GitHubs Governance-Infrastruktur für KI-Agenten, April 2026

https://www.shashi.co/2026/04/github-is-building-accountability-layer.html - The Future of Agentic Coding: Conductors to Orchestrators – Addy Osmani über den Wandel von Dirigenten zu Orchestratoren, AddyOsmani.com, 2026

https://addyosmani.com/blog/future-agentic-coding/ - This is the ONLY AI Skill You Need – Wes Roth über KI-assistierte Ausführung als Kernkompetenz, 2026

https://www.youtube.com/watch?v=Mz7W0qNlmOw